AI 에이전트를 실제 서비스에 올려본 사람이라면 공감할 이야기가 있다. 정작 시간이 가장 많이 드는 건 AI에게 뭘 시킬지 고민하는 부분이 아니다. 실행 환경 만들기, 로그인 토큰 관리, 중간에 끊겼을 때 다시 살리기, 서버 띄우기 같은 뒤치다꺼리가 전부다. Anthropic이 직접 밝힌 바로는 이런 인프라 작업에만 3~6개월이 걸린다고 한다.

2026년 4월 8일, Anthropic은 이 뒤치다꺼리를 자기네가 전부 가져가는 Claude Managed Agents를 공개 베타로 내놨다. 첫 소개 문서의 제목이 인상적이다. “두뇌와 손을 분리하자(Decoupling the brain from the hands)” — 생각하는 부분(AI 모델)과 실제로 일하는 부분(실행 환경)을 따로 관리하겠다는 선언이다.

핵심 요약 (먼저 결론부터)

- 에이전트 운영에 필요한 서버·세션·실행 환경을 Anthropic이 대신 관리한다

- 첫 응답이 나오기까지 걸리는 시간이 평균 60%, 최악의 경우 90% 이상 줄었다

- 요금은 실행 시간당 $0.08 + AI 사용료. 24시간 내내 돌리면 기본료만 월 약 $58

- AWS(Bedrock)나 Google Cloud(Vertex AI)에선 못 쓰고 Anthropic 서버 전용이다

- Notion, 일본 Rakuten, Asana가 이미 실제 서비스에 투입했다

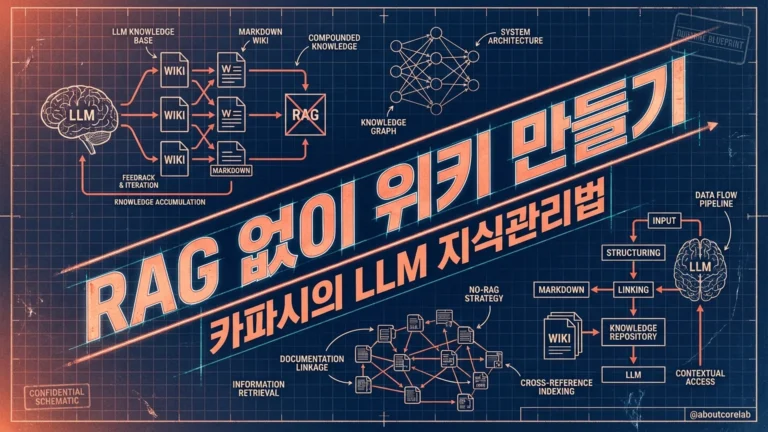

왜 ‘두뇌와 손을 분리’하자는 걸까

지금까지 에이전트를 만들 때 쓰던 도구들은 각자 약점이 뚜렷했다. LangGraph 같은 오픈소스는 자유도는 높지만 직접 운영하느라 손이 많이 간다. n8n, Zapier 같은 노코드 자동화 툴은 쓰기는 쉬운데 AI를 중심으로 일을 시키기가 애매하다. 그 사이 빈틈을 각 회사가 직접 만든 자체 실행 도구로 메워왔다.

이 자체 실행 도구를 Anthropic은 ‘하니스(harness, 마구)’라고 부른다. 말 그대로 말에게 씌우는 장비처럼 AI에게 씌우는 보조 코드다. Anthropic의 설명이 인상적이다.

하니스는 ‘Claude가 혼자선 못 할 것’에 대한 가정을 담은 코드다.

문제는 AI 모델이 빠르게 좋아진다는 점이다. 6개월 전에는 꼭 필요했던 재시도 로직이 이번 분기 모델에선 오히려 방해가 된다. 이래서 관리형 서비스가 나올 때가 됐다. 속은 계속 바뀌어도 사용자가 쓰는 인터페이스는 그대로 유지해주는 안정적인 껍데기가 필요한 것이다.

Anthropic 엔지니어링 블로그: 두뇌와 손을 분리한다는 개념

출처: Anthropic Engineering

어떻게 생겼나: 세 개의 부품으로 나눴다

Claude Managed Agents는 에이전트를 ‘운영체제처럼’ 설계했다. 부품을 세 개로 딱 잘라놨다.

| 구성요소 | 쉽게 말하면 | 역할 |

|---|---|---|

| Session (세션) | 전체 대화 기록장 | 에이전트가 한 모든 일이 순서대로 기록되는 로그 |

| Harness (하니스) | 지휘자 | AI를 호출하고 어떤 도구를 쓸지 결정하는 부분 |

| Sandbox (샌드박스) | 작업실 | 코드를 실행하고 파일을 다루는 격리된 공간 |

성능이 얼마나 좋아졌는지는 숫자로 나온다. 첫 응답이 나오기까지 걸리는 시간이 평균 약 60% 줄었고, 운 나쁜 경우(상위 5%)에도 90% 이상 줄었다. 원리는 단순하다. 예전에는 대화 한 번을 시작할 때마다 작업실(컨테이너)을 먼저 띄워놓아야 했다. 지금은 진짜 도구가 필요한 순간에만 작업실을 여는 방식이다. 단순한 질답은 아예 작업실을 안 열어도 된다.

중간에 서버가 죽어도 다른 서버가 세션 기록만 보고 이어서 처리할 수 있게 설계됐다. 대화 기록이 처음부터 끝까지 남아 있기 때문에 가능한 구조다.

보안도 꽤 공격적이다. 각종 로그인 토큰(OAuth)은 별도의 금고(Vault)에 두고, Claude가 만들어 실행하는 코드에는 절대 넘기지 않는다. 예를 들어 깃허브 코드를 받아올 때도 ‘받아오는 순간’에만 토큰이 쓰이고, 에이전트 실행 중에는 토큰이 노출되지 않는다. “AI한테 API 키를 통째로 주면 위험하다”는 상식이 런타임 수준에서 강제되는 셈이다.

요금: 시간당 $0.08이 뭘 의미하는가

가격표는 간단하다.

| 항목 | 단가 | 메모 |

|---|---|---|

| 실행 시간 | $0.08 / 시간 | 실제로 돌고 있을 때만. 멈춰 있으면 무료 |

| AI 사용료 | Claude API 표준 요금 | Sonnet 4.6 / Opus 4.6 |

| 웹 검색 | $1,000건당 $10 | |

| 쉬지 않고 돌리면 | 월 약 $58 | 기본료만, 24시간 × 30일 기준 |

시간당 $0.08이 싸 보이지만 동시에 수백 개 에이전트를 띄우면 금방 쌓인다. 다만 쉬는 시간엔 공짜라는 점이 특이하다. “회의록이 올라오면 깨어나서 할 일 목록으로 바꿔주고 다시 자는” 식의 패턴이면 월 비용이 훨씬 낮아진다.

실제로 써본 사람의 리뷰가 좋은 참고가 된다. 유튜버 Nick Saraev가 하루 종일 테스트해본 결과, 입력 230만 토큰 + 출력 2만 토큰을 썼는데 하루 비용이 $2.40, 한 달 누적 약 $24였다. 대부분 Sonnet 4.6을 썼고 가끔 Opus 4.6이 섞였다. 캐시 재사용도 눈에 띈다. 같은 시스템 프롬프트를 반복해서 쓸 때 할인이 적용된다는 뜻이다.

한 가지 걸리는 제약이 있다. 출시 초기엔 Anthropic 서버에서만 돌릴 수 있다. AWS의 Bedrock, Google의 Vertex AI로는 못 쓴다. 여러 클라우드를 섞어 쓰는 회사라면 바로 부딪히는 지점이다.

실제로 써본 느낌은 어떤가

Nick Saraev의 유튜브 리뷰 “Claude Managed Agents Just Dropped, And It Kills n8n”이 지금 나와 있는 가장 구체적인 실전 후기다. 인상적인 부분 몇 가지.

Nick Saraev의 실전 리뷰 영상

출처: Claude Managed Agents Just Dropped, And It Kills n8n — YouTube

첫째, 말로 시킨 대로 에이전트가 만들어진다. “영업 통화 녹취록 받아서 ClickUp에 할 일로 넣어줘” 한마디를 음성으로 녹음하면 Claude가 요구사항 문서를 쓰고 그대로 에이전트로 만들어준다.

둘째, 서버를 직접 띄울 필요가 없다. “Anthropic이 미리 세팅된 작업 공간을 내어준다”는 말이 핵심이다. 필요한 패키지도 깔려 있고 네트워크 규칙도 잡혀 있는 템플릿이 그대로 제공된다.

셋째, 모니터링이 기본으로 따라온다. AI가 호출한 내역, 걸린 시간, 누적 토큰, 세션 경과 시간이 대시보드에 바로 뜬다. 예전엔 LangSmith 같은 외부 도구를 별도로 붙여야 했던 부분이다.

리뷰어의 결론이 인상적이다.

n8n, Make, Zapier가 Claude Managed Agents보다 나은 점은 딱 하나, 화면에서 노드를 끌어다 연결하는 시각적 편집뿐이다. Anthropic이 이 부분만 해결하면 지식노동 자동화 도구 시장은 통째로 흔들릴 수 있다.

Claude Managed Agents 공식 문서 개요

출처: Anthropic Platform Docs

다른 도구들과 비교하면

2026년 4월 기준으로 주요 도구들의 위치를 정리하면 이렇다.

| 도구 | 잘하는 것 | 부족한 것 |

|---|---|---|

| LangGraph | 복잡한 흐름 설계, 상태 저장 | 배우기 어렵고 직접 운영해야 함 |

| CrewAI | 여러 에이전트 협업 빠른 시제품 | 대기업용 거버넌스 |

| OpenAI Agents SDK | 단순함, 몇 시간이면 돌아감 | 복잡한 시나리오 표현 |

| Google ADK | 이미지·영상 다루기, 구글 인프라 | 생태계 규모 |

| Claude Agent SDK + Managed Agents | 실행 환경까지 통째 제공 | Anthropic 서버 전용 |

Claude Managed Agents가 다른 것과 다른 점은 개발 도구와 실행 환경을 함께 주는 구조다. 다른 프레임워크는 개발 도구만 주고 실행은 사용자가 알아서 한다. 반면 AWS·구글 클라우드에서 못 쓴다는 점은 뼈아픈 약점이다.

이미 써본 회사들의 성과가 실용성을 보여준다. Notion은 수십 개 세션을 동시에 돌려 코딩과 콘텐츠 생성을 에이전트에게 맡겼고, Rakuten은 5개 부서에 전문 에이전트를 배치하면서 각각 1주일 안에 출시했다고 한다. Asana는 기능 출시 속도가 눈에 띄게 빨라졌다. Snowflake도 데이터 통합 파트너로 합류할 예정이다.

도입 전에 짚어야 할 리스크

장점만 나열하면 AI가 쓴 글 같아진다. 솔직히 풀어야 할 숙제가 꽤 있다.

특정 업체에 묶인다(벤더 락인). 해커뉴스에서도 가장 많이 지적된 부분이다. 지금은 Anthropic 말고 대안이 없다. 완화책 하나는 사내 시스템을 MCP 서버(AI가 외부 도구를 쓸 때 쓰는 표준 규격) 형태로 감싸두는 것이다. 이렇게 해두면 나중에 다른 모델이나 런타임으로 갈아탈 때 이식이 쉬워진다.

결과 검증은 여전히 내 몫이다. 문법이 맞는지는 알아서 확인해주지만 ‘내용이 맞는지’는 여전히 사용자가 봐야 한다. 에이전트가 만든 결과를 그대로 실서비스에 넣으면 위험하다. 현실적으론 외부에 팩트체크나 정책 검사 역할을 하는 에이전트를 한 번 더 거치는 이중 구조가 안전하다.

아직 초기 단계다. 일부 개발자는 현재 에이전트 프레임워크 전반을 “PHP 나오기 전 웹 수준”으로 비유한다. ‘리서치 프리뷰’로 표시된 메모리, 멀티 에이전트, 결과 평가 기능은 아직 실서비스 의존도를 낮추는 게 안전하다.

비용이 예상 밖으로 튈 수 있다. 시간당 $0.08이 작아 보여도 세션을 의식 없이 띄워두면 요금이 빠르게 쌓인다. 쉬는 시간 무료라는 특성을 살려 ‘필요할 때만 깨어나는’ 패턴이 기본이 되어야 한다.

내일부터 해볼 만한 것

관리형 에이전트는 ‘두 번째 클라우드‘에 비유할 만하다. 서버와 저장소를 AWS에 맡겼듯, 에이전트 실행 환경을 AI 회사에 맡기는 흐름이 시작됐다. 직접 만든 실행 도구를 유지하는 선택지는 이제 차별화가 명확한 핵심 영역에만 남겨두는 게 합리적이다.

당장 시도해볼 만한 건 ‘이벤트가 생기면 깨어나는’ 업무 하나를 Managed Agents로 옮겨보는 것이다. 회의록 → 할 일 변환, 영업 파이프라인 요약, 문의 티켓 자동 분류 같은 작업이 첫 후보다. 쉬는 시간 무료라는 특성과 정확히 맞물린다.

그 다음은 사내 시스템을 MCP 서버로 감싸두는 작업이다. Claude가 아닌 다른 모델이나 실행 환경으로 옮길 때 쓸 수 있는 ‘이식 가능한 층’이 한 겹 생긴다. MCP가 사실상 업계 표준이 되어가는 흐름이라, 도구 제공사 입장에서도 MCP 서버 제공은 유통 전략 그 자체다.

솔직히 아직 갈 길은 멀다. 시각적 편집이 빠져 있고, AWS·구글 클라우드 지원도 없으며, 내용 검증은 여전히 사용자 몫이다. 그래도 ‘두뇌와 손을 분리한다’는 설계 원칙 자체는 시간이 지날수록 옳다고 증명될 쪽이다. 이 판단에 동의하는지, 아니면 LangGraph 계열에 좀 더 머물 생각인지 의견이 궁금하다.

참고 자료

- Scaling Managed Agents: Decoupling the brain from the hands — Anthropic Engineering

- Claude Managed Agents overview — Anthropic Platform Docs

- Anthropic launches Claude Managed Agents — SiliconANGLE

- Anthropic Targets AI Data Center Bottleneck — Data Center Knowledge

- AI agents: Claude Managed launches in public beta — crypto.news

- Claude Managed Agents Just Dropped, And It Kills n8n — Nick Saraev, YouTube

- Hacker News 토론 스레드